دانشمندان چینی مدل هوش مصنوعی الهامگرفته از مغز ابداع کردهاند تا مصرف انرژی را کاهش دهند

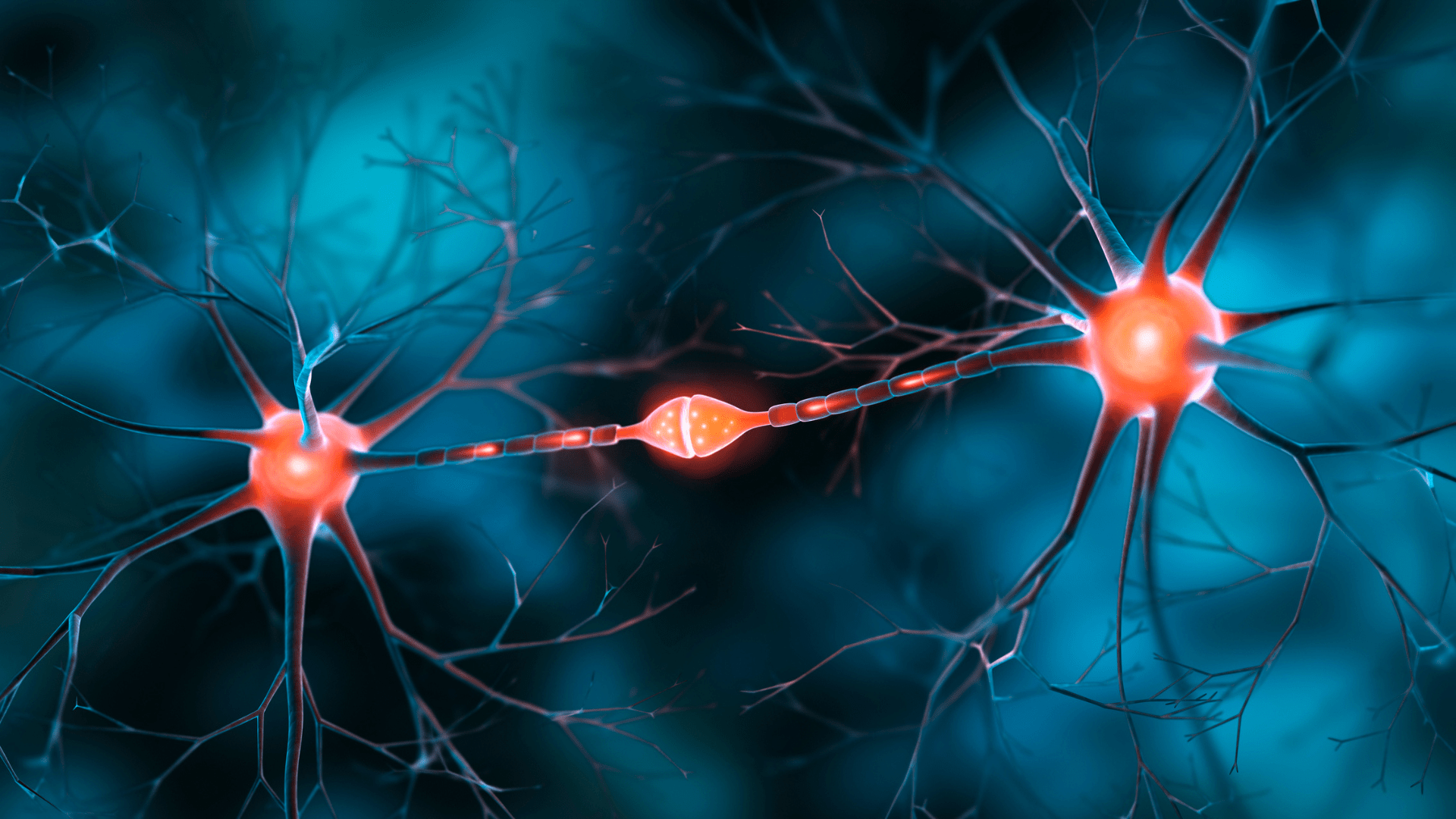

پژوهشگران چینی از یک دستاورد جدید خبر دادهاند که میتواند مسیر هوش مصنوعی (AI) را با استفاده از مدلی که رفتار نورونهای مغز انسان را کپی میکند، تغییر دهد.

این مدل جدید هوش مصنوعی که توسط تیم ایجاد شده میتواند بدون مصرف انرژی بسیار بالای پردازشگرهای سیلیکونی به قدرت محاسباتی دست یابد.

به گزارش South China Morning Post ، برای ایجاد این مدل، دانشمندان تلاش کردند تا فاصله بین عملکردهای بزرگ و پیچیده مدلهای هوش مصنوعی با عملکردهای داخلی پیچیده مغز انسان را پل بزنند.

تغییر جهت یافته که یافتههای تیم میتواند به سامانهای از توسعه هوش مصنوعی منجر شود که به پردازشگرها یا چیپهای سیلیکونی وابسته نیست.

نیاز به سیستمهای هوش مصنوعی با مصرف انرژی کمتر

در حالی که هوش مصنوعی کاربردهای بسیاری دارد، رشد آن همچنین به افزایش تقاضای انرژی منجر شده است. مدلهای هوش مصنوعی مصرف کنندگان بزرگ انرژی هستند و با نقش همواره گسترش یافته هوش مصنوعی در تمام زمینهها، این افزایش تنها افزایش خواهد یافت.

در مقابل، مغز انسان، پیچیدهتر از هر مدل هوش مصنوعی ایجاد شده تاکنون، به فقط کسری از انرژی نیاز دارد تا تمام وظایف خود را انجام دهد.

بنابراین، دانشمندانی از مؤسسه اتوماسیون آکادمی علوم چین و دانشگاه پکن با هدف توسعه مدلی از هوش مصنوعی که بتواند با مصرف انرژی بسیار کمتر، وظایف بیشتری انجام دهد، گردهم آمدند.

عملکرد مدل هوش مصنوعی بسیار سادهتر است و قصد دارد با استفاده از مدلهای چندمنظوره بهتر تواناییهای شناختی ایجاد کند.

مدل جدید بر اساس عملکردهای داخلی مغز انسان

دانشمندان مشغول به پروژه از مدل جدید به عنوان «مدل پیچیدگی داخلی» یاد میکنند. این نامگذاری به دلیل تلاش برای تقلید عملکردهای داخلی مغز به منظور انجام وظایف با استفاده از کسری از انرژی است.

به گزارش Xinhua ، آزمایشهای انجام شده توسط تیم پژوهشی، اثربخشی مدل پیچیدگی داخلی در انجام وظایف مختلف را ثابت کردند.

آزمایشها همچنین نشان داد که میتواند روشها و پشتیبانی نظری جدیدی برای ادغام ویژگیهای دینامیکی عصبشناسی در هوش مصنوعی فراهم کند و همچنین راهحلهای قابل اجرا برای بهینهسازی و ارتقای عملکرد عملی مدلهای هوش مصنوعی ارائه دهد.

بر اساس مقاله، محققان توانستند یک شبکه Hodgkin-Huxley (HH) با پیچیدگی داخلی غنی بسازند تا اثبات کنند که عملکرد آن برابر با شبکههای بسیار بزرگتر leaky integrate-and-fire (LIF) است.

این مطالعه به تازگی در مجله Nature Computational Science منتشر شده است.

چکیده

پژوهشگران هوش مصنوعی (AI) معتقدند که رویکرد اصلی برای ساخت مسائل مدل عمومیتر با مدل بزرگ هوش مصنوعی مرتبط است، جایی که شبکههای عصبی موجود عمیقتر، بزرگتر و گستردهتر میشوند. ما این را رویکرد مدل بزرگ با پیچیدگی خارجی مینامیم. در این کار، ما استدلال میکنیم که رویکرد دیگری به نام مدل کوچک با پیچیدگی داخلی وجود دارد که میتواند برای یافتن مسیر مناسب برای ادغام ویژگیهای غنی در نورونها به منظور ساخت مدلهای هوش مصنوعی بزرگتر و کارآمدتر استفاده شود. ما کشف میکنیم که باید مقیاس شبکه را از خارج افزایش دهید تا همان ویژگیهای دینامیکی را تحریک کند. برای مثال، ما یک شبکه Hodgkin-Huxley (HH) با پیچیدگی داخلی غنی میسازیم، جایی که هر نورون یک مدل HH است، و اثبات میکنیم که ویژگیهای دینامیکی و عملکرد شبکه HH میتواند برابر با شبکه بزرگتر leaky integrate-and-fire (LIF) شود، جایی که هر نورون یک نورون LIF با پیچیدگی داخلی ساده است.